Si bien las laptops modernas traen unidades NPU integradas para tareas ligeras de inteligencia artificial, la verdadera revolución del procesamiento masivo está ocurriendo en los cuartos de los entusiastas tecnológicos. En 2026, la tendencia más candente en el nicho del hardware pesado es el “Home AI Server”.

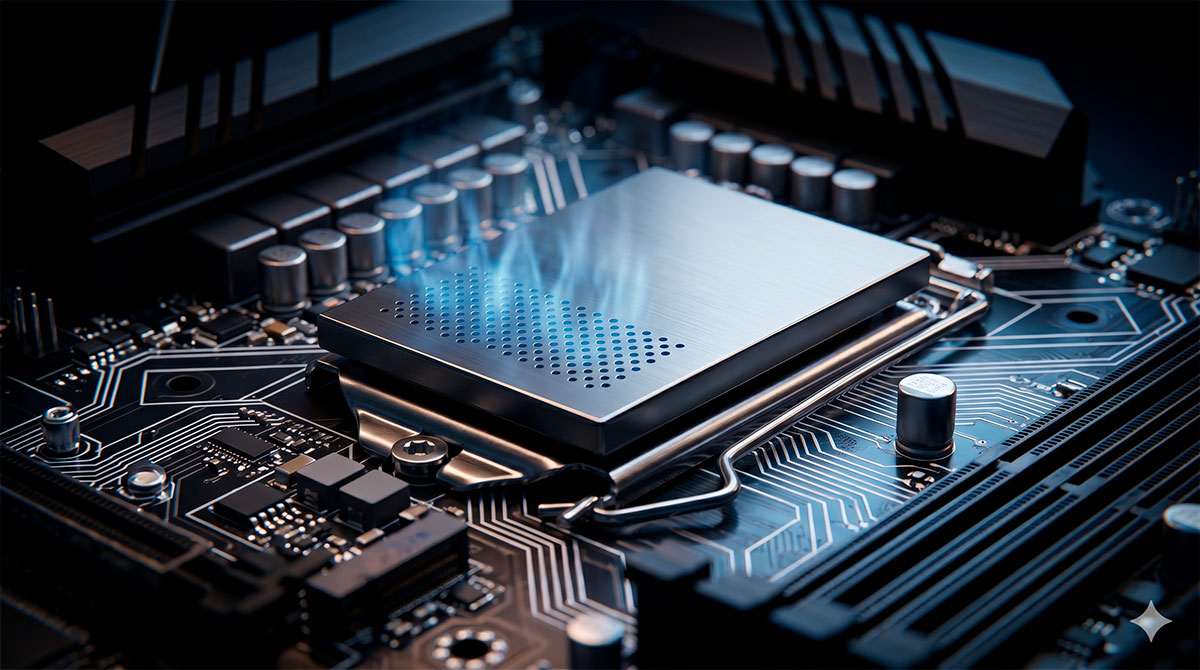

Ya no basta con tener un PC tradicional. Para correr modelos de lenguaje masivos, generar video en tiempo real de forma local o alimentar sistemas de seguridad perimetral complejos sin pagar suscripciones en la nube, se requiere músculo. Estamos viendo cómo los usuarios de alto rendimiento combinan procesadores de tope de línea, como la familia Intel Core i9 de 14ª generación en adelante, con GPUs de grado servidor.

Las tarjetas gráficas aceleradoras, como la NVIDIA Tesla P40 (y sus equivalentes modernas de arquitectura Blackwell), diseñadas originalmente para centros de datos, se están adaptando con sistemas de refrigeración personalizados para gabinetes domésticos. Su enorme cantidad de VRAM permite cargar modelos enteros en la memoria local. Este artículo desglosa qué componentes necesitas para armar tu propia bestia de cálculo neuronal en casa y liberarte de la dependencia de OpenAI o Google.

Deja una respuesta