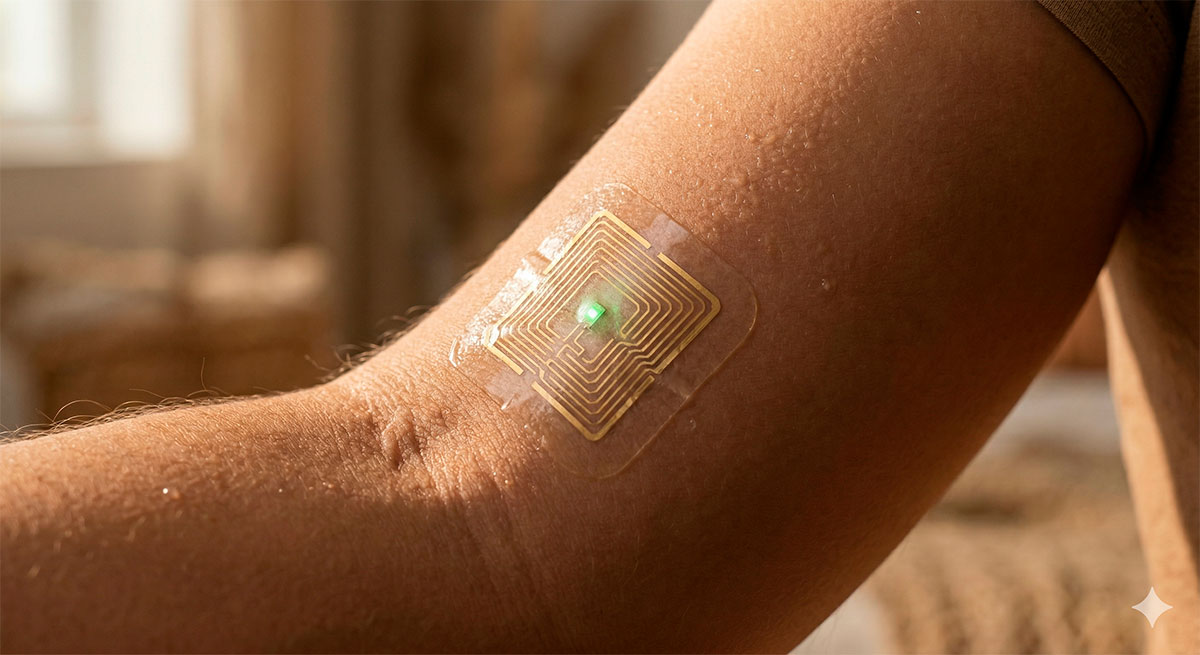

Durante años, las gafas inteligentes (Smart Glasses) intentaron impresionarnos proyectando pantallas flotantes gigantes en nuestro living o mostrando notificaciones simples. Era curioso, pero no indispensable. Este marzo de 2026, el paradigma ha cambiado radicalmente con la llegada de las primeras gafas de Realidad Aumentada (AR) impulsadas por Inteligencia Artificial Multimodal.

La IA ahora tiene ojos y oídos La gran diferencia de los modelos lanzados este año por líderes como Meta (evolución de Orion) y Apple (versión ligera de Vision) es que la IA ya no vive solo en la nube esperando comandos de voz. Gracias a micro-cámaras y micrófonos direccionales de alta fidelidad, la IA que vive en la montura de las gafas ve y escucha tu entorno en tiempo real.

Imagina que estás caminando por el centro de Santiago y ves un edificio histórico, un restaurante o incluso una planta que no reconoces. Con solo mirar el objeto y preguntar: “¿Qué es esto?”, la IA Multimodal procesa la imagen y el contexto, y proyecta una sutil etiqueta holográfica directamente en tu campo de visión con la respuesta, reseñas o datos históricos, sin que tengas que sacar el teléfono.

Asistencia contextual invisible En un entorno de trabajo o académico, estas gafas son revolucionarias. Si estás reparando un motor o ensamblando un mueble, la IA detecta qué herramienta tienes en la mano y proyecta diagramas o flechas sobre el objeto real, guiándote paso a paso. No es una pantalla invasiva; es información contextual que se fusiona perfectamente con el mundo físico. En planetatecno.cl creemos que, con la reducción de peso lograda este año (menos de 80 gramos), finalmente estamos ante el hardware que comenzará a jubilar al smartphone.

Deja una respuesta